On décode la tech’ – Épisode #9

« Blockchain », « IA », « deep learning », « ransomware »… Le monde de la tech a son propre jargon et ses concepts qui, soyons honnêtes, laissent parfois un peu perplexe. Même si ces technologies font désormais partie de notre quotidien, leur fonctionnement reste souvent un mystère pour beaucoup (y compris vous, ne mentez pas). Dans cette série, nous retroussons nos manches en vulgarisant certaines de ces notions pour en comprendre l’essentiel. Alors, que vous soyez un geek en devenir ou un néophyte un peu perdu, embarquez avec nous dans les fascinants méandres de la tech’ !

On les croise partout, ces vidéos un peu trop parfaites où les visages parlent sans avoir parlé. Bienvenue dans le monde des deepfakes : ces images et ces voix générées par intelligence artificielle qui imitent le réel à s’y méprendre. Longtemps cantonnés aux réseaux internationaux, ils circulent désormais aussi dans nos conversations locales, sur nos téléphones, dans nos groupes. Ce n’est plus un gadget : c’est un vrai défi pour notre regard et notre confiance. Alors, c’est quoi exactement un deepfake, comment on le repère, et pourquoi ça nous concerne tous ? On décode.

__

Fake news vs deepfakes : quelle différence ?

Les « fake news » sont des contenus informationnels – textes, images, vidéos – qui véhiculent une information fausse ou trompeuse, souvent diffusés pour manipuler l’opinion ou provoquer un effet. Ce sont des messages erronés, de la désinformation ou de la rumeur amplifiée.

Les deepfakes, eux, entrent dans un autre registre : ce sont des contenus générés ou modifiés par IA – photo, vidéo, audio – qui imitent de façon très crédible quelqu’un ou quelque chose qu’on croyait authentique. Le visage d’une personne qui fait ou dit quelque chose qu’elle n’a jamais fait. La voix d’un dirigeant qui annonce une info qu’il n’a jamais annoncée.

En résumé, toute fake news n’est pas un deepfake, mais tout deepfake est une forme très sophistiquée de fake news ou d’outil de désinformation. Le support est transformé ; la tromperie va jusque-là. Si vous vous dites « non, ça ne peut pas m’arriver ici », rappelez-vous que le geste de création est plus fort que le texte, l’image ou la voix. Et qu’un visage « familier » ou une voix « connue » peut être fabriqué.

__

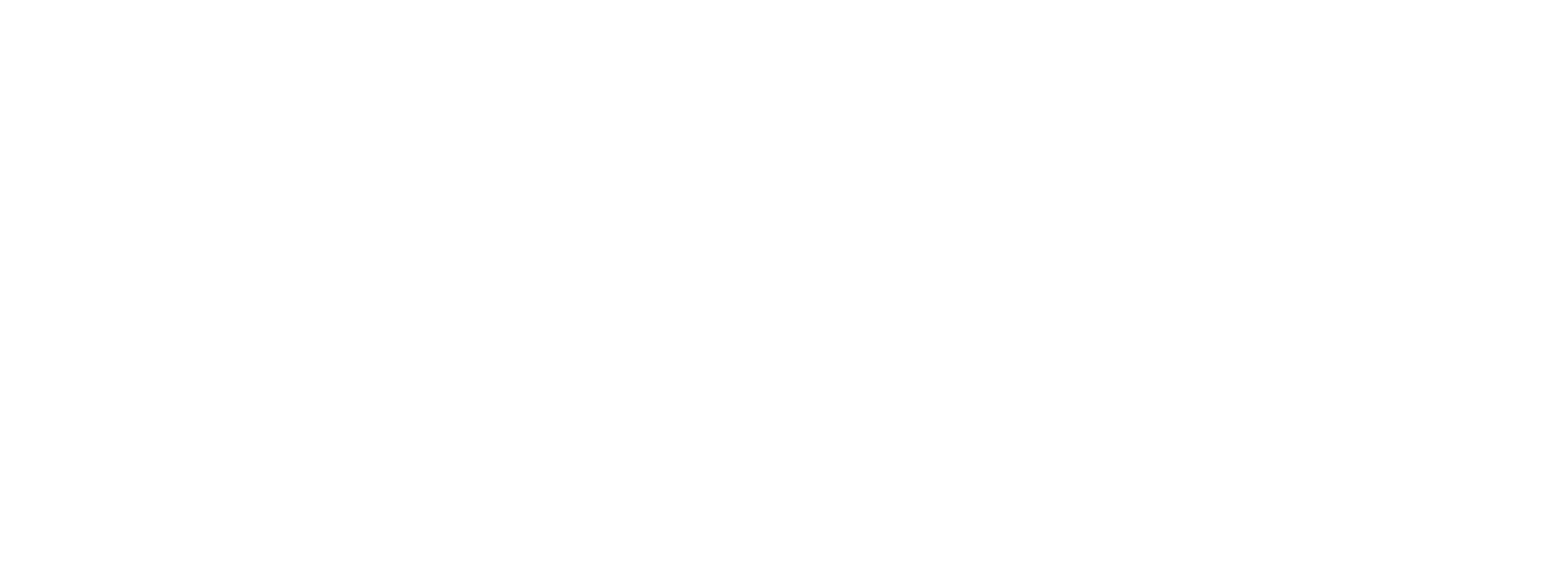

Comment ça marche ? Comment les deepfakes fonctionnent ?

Sans rentrer dans la techno ultra-pointue, voici les grandes étapes : l’IA collecte des images ou extraits audio d’une personne (visage, expressions, voix). Elle les analyse via des réseaux de neurones (GAN, auto-encodeurs…) pour apprendre les traits, la manière de parler, les micro-expressions. Puis elle génère un nouveau média : « voici cette personne disant ou faisant ceci ». Le résultat : on jurerait que c’est réel.

Ce qui rend tout ça aussi redoutable, c’est que les outils sont désormais à portée de clic, avec des applis grand public aussi simples qu’un filtre photo, que la qualité s’améliore à vue d’œil à chaque mise à jour, et que, malgré tout, on continue de faire confiance à ce qu’on voit et à ce qu’on entend.

D’après une étude menée en 2024 par Sumsub, une entreprise spécialisée dans la vérification d’identité numérique, le nombre de deepfakes détectés dans le monde a été multiplié par dix entre 2022 et 2023. Le rapport se base sur des milliers d’incidents répertoriés auprès de grandes plateformes et d’entreprises de cybersécurité, ce qui en fait l’un des baromètres les plus suivis du secteur — même si, bien sûr, il ne couvre que les cas identifiés.

__

Et en Nouvelle-Calédonie, on est concernés ?

Les deepfakes ne s’arrêtent pas aux frontières : ils circulent ici comme ailleurs, entre blagues virales et manipulations plus douteuses. Dans le genre le plus caricatural, on se souvient de cette vidéo où des membres du gouvernement, dopés à l’IA, chantaient du reggae sur les galères du territoire. Personne n’y a cru, mais tout le monde a ri : la blague montrait surtout à quel point cette technologie est devenue simple à manier.

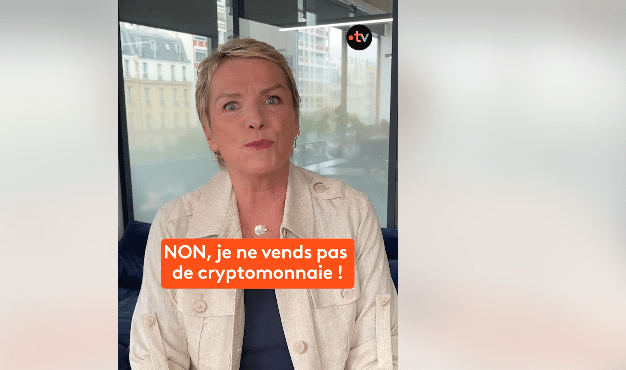

Plus troublant, plusieurs journalistes nationaux mais également de NC La 1ère et de Caledonia ont vu leur visage et leur voix détournés pour faire la promo de plateformes de crypto-monnaies. Cette fois, le ton et le décor étaient crédibles : de quoi piéger plus d’un internaute.

Entre le gag et la supercherie, il y a toute une zone grise. Un regard qui cligne trop peu, une bouche qui ne colle pas tout à fait, une lumière étrange… Si une vidéo paraît trop parfaite ou trop belle pour être vraie, c’est sans doute qu’elle ne l’est pas. Le réflexe, c’est de douter, vérifier, comparer et éviter le partage automatique.

__

Quand la blague tourne au problème

Le vrai danger, ce n’est pas seulement la désinformation : c’est la perte de confiance. Quand on ne sait plus si une image, une voix ou une vidéo est réelle, tout vacille — les infos, les transactions, les relations, même la parole publique.

À l’échelle mondiale, les deepfakes pèsent déjà sur l’économie. Des arnaques en ligne utilisent des visages clonés pour soutirer de l’argent, de faux dirigeants d’entreprise donnent des ordres imaginaires par visioconférence, et des vidéos truquées influencent des décisions d’investissement. Ce n’est plus de la science-fiction, c’est du quotidien.

Et ici comme ailleurs, le risque est le même : si chacun doute de tout, c’est la confiance collective qui s’effondre. Et sans confiance, ni business, ni démocratie, ni conversation ne tiennent bien longtemps.

__