Les croissants numériques sont organisés par OPEN NC et ont pour objectif de laisser la parole à un membre du cluster numérique pour faire une présentation sur le sujet de son choix. « Redynamiser la formation aux métiers du l’informatique », « l’emploi des personnes en situation de handicap dans la filière numérique » ou encore la présentation d’une solution… tous les sujets sont bons tant qu’il y a un lien avec le numérique.

Cette fois, Philippe Gauvin, gérant de DPO Consulting Pacifique, a pris les rênes du croissant numérique du mois de mars sur le thème : « l’Intelligence Artificielle au service des politiques locales de sécurité et de prévention de la délinquance ». Un sujet prenant et délicat qui a su réunir différents acteurs de l’écosystème calédonien : Eve Chiapello d’Actecil Nouvelle-Calédonie, Nicolas Mathey de la SLN – Le Nickel, Thomas Monnin de la Police nationale, Lydia Fambart Gracia de Faidyl, Julien Roth d’Infobam, Laurent Rivaton d’AdDo et la rédac’ de NeoTech.

__

L’IA et la vidéo, une connexion longtemps établie

Lorsqu’on évoque l’intelligence artificielle (IA), notre esprit se tourne souvent vers des technologies telles que ChatGPT. Pourtant, ce domaine englobe bien plus, incluant la robotique, le secteur médical, et bien sûr, la vidéo. Philippe Gauvin a souligné cette diversité lors d’une présentation centrée sur l’IA appliquée à la sécurité. Il a retracé rapidement l’historique, mettant en lumière le lien entre l’évolution de la société et l’essor de la vidéosurveillance. Le rapport Peyrefitte de 1977, premier document à signaler une montée de la violence, a conduit à la loi Pasqua de 1995, légalisant la vidéosurveillance dans les lieux publics. Même après près de cinquante ans, la vidéo reste une technologie évolutive, constamment soumise à de nouvelles réglementations par la CNIL.

Les Jeux Olympiques de 2024 ont marqué le début de débats intenses, notamment en raison de l’article 10 de la loi de 2023 relative aux JO, autorisant temporairement la vidéosurveillance algorithmique (VSA). Cette mesure a suscité des inquiétudes, notamment quant à la protection de la vie privée liée à la reconnaissance faciale. Récemment, il y a eu un « premier test de calibrage » de la VSA lors du concert de Dépêche Mode à Paris pour détecter des comportements suspects sans faire appel à la reconnaissance faciale. Résultat des courses ? Un bilan mitigé d’une technologie controversée obscure dont le public ne connaît pas bien les tenants et les aboutissants.

« Il faut regarder si c’est utile ou pas pour sécuriser un évènement, et il faut définir le bon équilibre. La CNIL a appelé à ce qu’il n’y ait pas une surveillance permanente, automatisée et partout dans l’espace public pour tous type d’infraction. »

Louis Dutheillet de Lamothe de la CNIL

__

La cohabitation entre le droit des hommes et l’intelligence artificielle

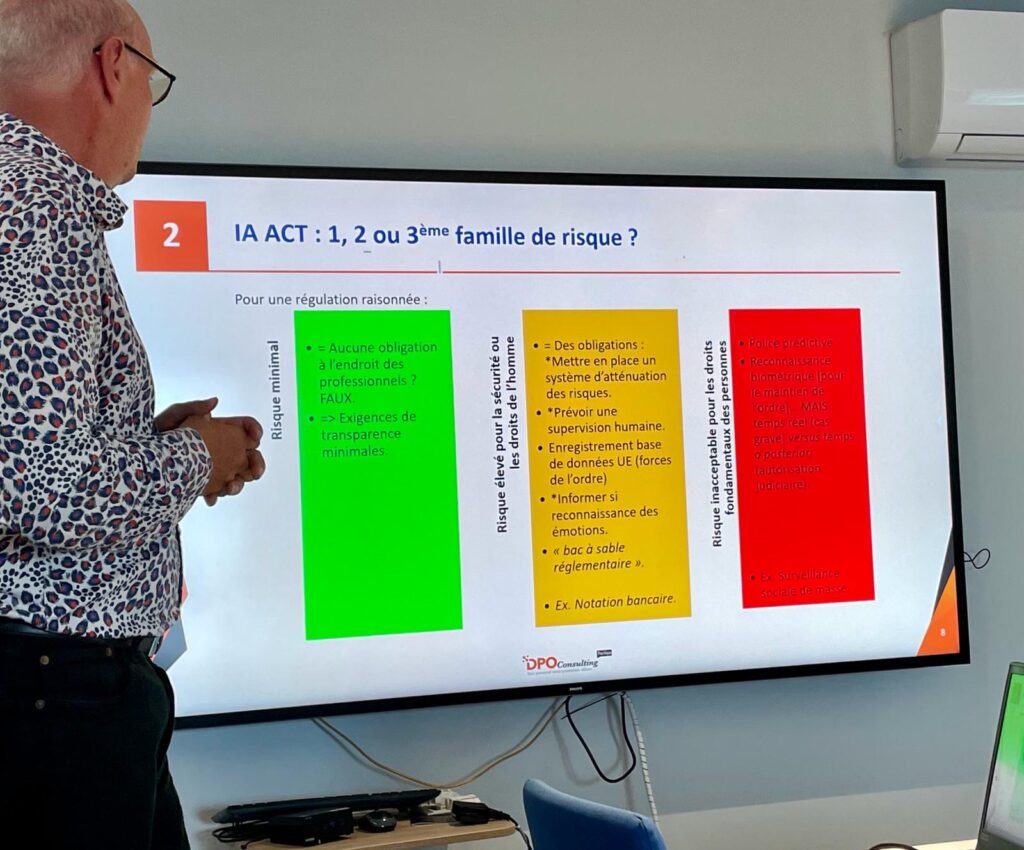

Philippe Gauvin a soulevé de façon pertinente l’importance de l’IA Act, une législation récemment adoptée visant à instaurer une régulation raisonnée de l’intelligence artificielle. Cette initiative représente un jalon historique en offrant une clarté juridique quant à l’utilisation de l’IA au sein de l’Union européenne. Cette loi classe les risques liés à l’IA en quatre catégories : minimal, élevé, très élevé et inacceptable. Parmi les éléments jugés « à risque inacceptable », figure la reconnaissance biométrique en temps réel, notamment utilisée pour la surveillance de masse, une pratique socialement controversée.

Cependant, l’objet de ce croissant numérique a été d’apporter des nuances à cette interdiction. Bien que la reconnaissance biométrique « en temps réel », ou vidéosurveillance automatisée (VSA), soit proscrite dans des contextes tels que l’évaluation sociale, l’exploitation des faiblesses individuelles, la détection des émotions au travail, ou l’identification biométrique à distance dans les espaces publics à des fins répressives, des exceptions ont été établies, principalement pour les forces de l’ordre, mais uniquement « a posteriori ».

Ces exceptions autorisent l’utilisation de la technologie lorsque l’intérêt public l’emporte sur les risques pour les droits fondamentaux. Par exemple, la recherche ciblée de victimes potentielles d’infractions, la prévention de menaces spécifiques et imminentes pour la vie ou la sécurité physique, la lutte contre le terrorisme, ainsi que la détection, la localisation, l’identification ou la poursuite de personnes soupçonnées de crimes graves. Cette distinction entre vidéosurveillance et vidéoprotection prend alors tout son sens dans ce cadre réglementaire.

__

L’IA à des fins de sécurité et de prévention de la délinquance

Seulement, ces situations peuvent se retrouver dans des lieux privés. Alors, aborder la question de l’autorisation de l’IA dans les lieux privés, tels que la SLN Le Nickel, soulève des questionnements. Les entreprises privées, en particulier celles opérant dans des secteurs sensibles comme l’industrie minière, peuvent bénéficier de l’intégration de technologies d’IA dans leurs stratégies de sécurité. La SLN Le Nickel, par exemple, fait face à divers défis en matière de sécurité, notamment la surveillance de vastes sites industriels, la protection des équipements critiques et la prévention des intrusions ou des incidents dangereux. Dans ce contexte, l’utilisation de systèmes d’IA, tels que la vidéosurveillance algorithmique, pourrait offrir des avantages significatifs en améliorant la détection précoce des menaces et en renforçant la réactivité face aux incidents potentiels.

Cependant, l’intégration de telles technologies dans des environnements privés soulève également des préoccupations similaires à celles rencontrées dans les espaces publics, notamment en ce qui concerne la protection de la vie privée des employés et des sous-traitants ainsi que la gestion appropriée des donnéescollectées. Il est donc crucial d’établir des cadres juridiques et éthiques robustes pour encadrer l’utilisation de l’IA dans ces contextes, en veillant à ce que les droits individuels soient respectés et que les risques potentiels soient correctement atténués. La question centrale demeure : où doit-on placer le curseur de la surveillance algorithmique dans ces environnements privés ?

« La technologie n’est pas destinée à remplacer ou mettre en péril l’humain, cependant, si nous ne lui donnons pas les moyens nécessaires, elle risque de faire un flop. L’intelligence artificielle peut aider les opérateurs à être plus alertes, proactifs et capables de réagir aux alertes, mais il est essentiel de s’adapter et d’explorer les différentes possibilités qu’elle peut nous apporter. »

__